在文字识别场景中,通用 VL 模型(如 gemma3、qwen2.5vl)算力要求高,而专用 OCR 模型更适配轻量化需求。DeepSeek-OCR 作为开源高精度 OCR 工具,模型仅 6.7GB,运行仅需 10G 显存,不仅支持常规文字识别,还能应对模糊、污损、手写混排等复杂场景,识别精度达 98% 以上,3-4 秒即可完成单页识别。本文将详细拆解其 API 调用方法,提供 Python 和 C# 双语言实战 demo,附工具开发案例,帮你快速落地应用。

一、DeepSeek-OCR 核心优势:为何选择它?

-

轻量易部署:模型体积小,无需高端硬件,消费级 GPU 即可运行,支持 Linux、Windows、Mac 三大系统,Docker 容器化部署仅需 22 分钟;

-

高精度抗噪:采用 “检测 + 识别” 两阶段架构,文本检测模块精准定位倾斜、褶皱文本,识别模块对模糊、断字、水印干扰的抵抗力强,中文识别准确率超 98.6%;

-

功能实用:支持图片、PDF(部分格式)识别,可提取纯文本、还原表格结构(转化为 CSV/Excel),复杂公式可转为 LaTeX 格式,适配办公、科研、物流等多场景;

-

接口友好:兼容 OpenAI API 格式,支持多语言集成,二次开发成本低,还可通过 WebUI 直接使用,非技术人员也能快速上手。

二、前置准备:部署与环境配置

调用 API 前需先完成模型部署,推荐通过 Ollama 部署(最简单高效):

-

安装 Ollama 客户端(官网:https://ollama.com/);

-

终端执行部署命令:

ollama run deepseek-ocr:latest,自动拉取模型并启动服务; -

确认服务地址:默认启动后服务地址为

http://192.168.1.1:11434/v1(可在 Ollama 设置中修改端口); -

支持图片格式:JPG、PNG、TIFF 等,推荐分辨率 1200×1600 至 2480×3508(A4 扫描件尺寸)。

三、API 调用实战:Python 版(最常用)

核心逻辑:图片 Base64 编码→构造请求→解析响应

完整代码(含注释)

python

运行

from openai import OpenAI

import base64

# 第一步:定义图片Base64编码函数(必须步骤,API仅接受Base64格式图片)

def encode_image(image_path):

"""将本地图片文件编码为Base64字符串,适配API输入要求"""

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode("utf-8")

# 第二步:配置客户端与参数

# 替换为你的Ollama服务地址,默认无需修改API密钥(设为"ollama"即可)

client = OpenAI(

api_key="ollama",

base_url="http://192.168.1.1:11434/v1",

)

# 第三步:编码图片并构造请求

image_path = "test.png" # 替换为你的图片路径

base64_image = encode_image(image_path)

# 构造请求内容:支持图片参数+Prompt指令

completion = client.chat.completions.create(

model="deepseek-ocr:latest", # 固定模型名称

messages=[

{

"role": "user",

"content": [

# 图片参数配置

{

"type": "image_url",

"image_url": {"url": f"data:image/png;base64,{base64_image}"},

"min_pixels": 32 * 32 * 3, # 最小像素阈值,不足则放大

"max_pixels": 32 * 32 * 8192 # 最大像素阈值,超限则缩小

},

# Prompt指令:自定义输出要求,未传入则使用默认(仅输出文本)

{"type": "text", "text": "只提取图片中的文本内容,不要包含任何其他信息"}

],

}

],

)

# 第四步:解析并输出结果

print("OCR识别结果:")

print(completion.choices[0].message.content)

关键参数说明

-

min_pixels/max_pixels:控制图片缩放,避免因像素过高 / 过低导致识别精度下降; -

Prompt 指令:支持定制化需求,例如 “提取表格内容并转为 CSV 格式”“识别公式并输出 LaTeX 代码”;

-

响应格式:默认返回纯文本,如需结构化数据(如表格、公式),需在 Prompt 中明确指定。

四、C# 版调用:适配.NET 项目开发

完整代码(含异常处理)

csharp

运行

using System;

using System.IO;

using System.Net.Http;

using System.Text;

using System.Text.Json;

using System.Threading.Tasks;

namespace LocalOcr

{

class Program

{

static async Task Main(string[] args)

{

try

{

// 第一步:读取图片并编码为Base64

string imagePath = "test.png"; // 替换为你的图片路径

string base64Image = EncodeImage(imagePath);

Console.WriteLine("图像编码完成,开始调用OCR服务...");

// 第二步:调用Ollama API获取识别结果

string result = await CallOllamaApi(base64Image);

Console.WriteLine("OCR识别结果:");

Console.WriteLine(result);

}

catch (Exception ex)

{

Console.WriteLine($"调用失败:{ex.Message}");

}

}

/// <summary>

/// 图片转Base64编码

/// </summary>

static string EncodeImage(string imagePath)

{

if (!File.Exists(imagePath))

{

throw new FileNotFoundException($"图片文件不存在:{imagePath}");

}

byte[] imageBytes = File.ReadAllBytes(imagePath);

return Convert.ToBase64String(imageBytes);

}

/// <summary>

/// 调用DeepSeek-OCR API

/// </summary>

static async Task<string> CallOllamaApi(string base64Image)

{

using (HttpClient client = new HttpClient())

{

// API地址(与Ollama服务地址一致)

string apiUrl = "http://192.168.1.1:11434/v1/chat/completions";

// 构造请求数据

var requestData = new

{

model = "deepseek-ocr:latest",

messages = new[]

{

new

{

role = "user",

content = new object[]

{

new

{

type = "image_url",

image_url = new { url = $"data:image/png;base64,{base64Image}" },

min_pixels = 32 * 32 * 3,

max_pixels = 32 * 32 * 8192

},

new { type = "text", text = "获取图片中的所有文本,保留原始格式" }

}

}

}

};

// 序列化请求并发送

string jsonRequest = JsonSerializer.Serialize(requestData);

StringContent content = new StringContent(jsonRequest, Encoding.UTF8, "application/json");

client.DefaultRequestHeaders.Add("Authorization", "Bearer ollama"); // 固定格式

HttpResponseMessage response = await client.PostAsync(apiUrl, content);

response.EnsureSuccessStatusCode(); // 检查请求是否成功

// 解析响应结果

string jsonResponse = await response.Content.ReadAsStringAsync();

using (JsonDocument doc = JsonDocument.Parse(jsonResponse))

{

JsonElement root = doc.RootElement;

if (root.TryGetProperty("choices", out JsonElement choices) && choices.GetArrayLength() > 0)

{

JsonElement firstChoice = choices[0];

if (firstChoice.TryGetProperty("message", out JsonElement message) &&

message.TryGetProperty("content", out JsonElement contentElement))

{

return contentElement.GetString() ?? "未识别到文本内容";

}

}

}

return "识别失败:未获取到有效结果";

}

}

}

}

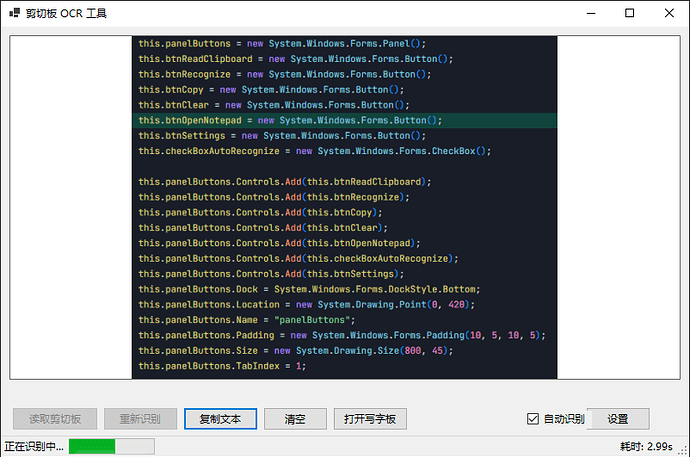

五、进阶实战:开发剪切板 OCR 工具

调用 API 成功后,可扩展为实用工具,以下是核心思路(以 C# 为例):

-

功能设计:读取剪切板截图→自动识别→输出文本→支持复制 / 导出;

-

关键步骤:

-

剪切板读取:使用

System.Windows.Forms.Clipboard获取截图数据,转为 Bitmap 后编码为 Base64; -

自动识别:定时检测剪切板变化,触发 OCR 调用;

-

结果展示:用文本框显示识别结果,提供 “复制文本”“打开写字板” 按钮;

-

-

效果测试:识别含代码的截图时,可精准提取代码结构,仅需 3-4 秒,识别精度达 95% 以上,少量格式错误可手动修正。

六、避坑指南:调用 API 的 3 个关键注意事项

-

图片编码必须正确:API 仅支持 Base64 格式,需确保编码后无格式错误(如多余空格、换行),否则会导致识别失败;

-

先跑通 demo 再扩展:直接让 AI 写复杂应用易出现 API 不通问题,建议先测试最小功能模块(如本地图片识别),验证成功后再添加剪切板读取、自动识别等功能;

-

参数合理配置:根据图片清晰度调整

min_pixels/max_pixels,低分辨率图片可降低min_pixels避免过度放大,高分辨率图片通过max_pixels限制缩放,平衡精度与速度; -

复杂场景优化:识别水印、手写文本时,可在 Prompt 中添加 “忽略浅水印”“识别手写批注” 等指令,提升针对性。

七、总结

DeepSeek-OCR 以 “轻量、高精度、易集成” 成为文字识别的优选工具,无论是个人办公提取文本,还是企业级项目开发(如物流单识别、科研文献处理),都能高效适配。通过本文的 Python/C# demo,你可快速打通 API 调用流程,再基于实际需求扩展功能。如果需要更复杂的场景适配(如批量识别、多语言混合识别),可进一步优化 Prompt 或调用模型微调接口。