国产大模型再迎重磅突破!2026 年 3 月 2 日晚间,阿里正式开源 Qwen3.5 系列四款小尺寸模型 ——Qwen3.5-0.8B/2B/4B/9B,全系列支持笔记本、移动端等端侧设备部署,凭借超高的智能密度和极致的轻量化设计,不仅引爆全球开发者圈,更让马斯克空降评论区直呼 “令人惊叹的智能密度”,成为国产端侧大模型的又一标杆。

此次开源的 Qwen3.5 小模型系列,均基于 Qwen3.5 统一基座打造,承袭了原生多模态、优化架构、规模化强化学习的核心优势,且采用 Apache 2.0 协议开源可商用,支持 LoRA / 全量微调,消费级显卡即可完成任务适配,真正实现了 “低算力高智能” 的端侧落地目标。

实测封神!9B 性能碾压云端旗舰,多项评测登顶

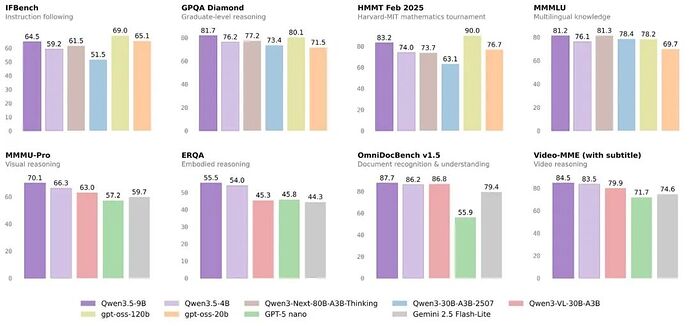

Qwen3.5 小模型的实力,在指令跟随、多语言处理、视觉推理、长上下文理解等多项权威基准评测中得到极致验证,其中Qwen3.5-9B更是表现炸裂,在 GPQA Diamond、MMMU-Pro、ERQA、Video-MME 等核心评测中拔得头筹,大幅领先 GPT-OSS-20B、GPT-5 nano、Gemini 2.5 Flash-Lite,甚至超越了阿里自家的 Qwen3-Next-80B-A3B-Thinking、Qwen3-30B-A3B-2507 等大参数模型。

就连定位稍低的Qwen3.5-4B也表现亮眼,在多语言知识、视觉推理、文档理解等任务上媲美更大参数模型,仅在纯数学推理这类高难度任务上存在小幅差距,这也是小尺寸模型的普遍特性。有海外开发者直言,Qwen3.5-9B 在 MMMU-Pro 测试中以 13 分优势击败 GPT-5 Nano,是真正的亮点:“能在笔记本上运行的模型,性能却超越云端旗舰,这证明架构优势远胜于单纯的参数数量。”

更让人惊喜的是,有开发者实测 Qwen3.5-9B,在 AMD Ryzen AI Max+395 处理器、Q4_K_XL 量化算法下,开启完整 256k 上下文窗口,处理速度可达 30 token/s,且显存占用不到 16GB。该开发者惊叹,这款小模型虽体积小巧,但多语言处理、通用知识储备、视觉输入处理能力均十分强悍,是端侧部署的绝佳选择。

全尺寸适配!四款模型各有所长,覆盖全场景端侧需求

阿里此次开源的四款 Qwen3.5 小模型,针对不同端侧场景做了精准优化,从 0.8B 到 9B 形成完整的产品矩阵,满足从移动 IoT 到轻量级智能体、低显存服务器的全场景需求,真正做到 “按需选择,算力适配”。

-

0.8B/2B:极致小巧、运行快速,是端侧部署首选,适配手机、IoT 边缘设备等轻量硬件,适合低延时的实时交互场景,为移动智能应用提供核心算力支持;

-

4B:性能进阶,具备原生多模态能力,是轻量级 AI 智能体的理想 “大脑”,能完美平衡性能与资源消耗,为 OpenClaw 这类智能代理工具提供核心支撑;

-

9B:结构紧凑但性能强悍,媲美 GPT-OSS-120B 大参数模型,适合需要较高智能水平但显存资源受限的服务器端部署,是性价比极高的通用型模型,兼顾性能与落地成本。

这也让 Qwen3.5 家族的开源版图更加完整,目前已形成1 个大尺寸 + 3 个中型尺寸 + 4 个小尺寸的全矩阵布局,从超大规模云端模型到极致轻量化端侧模型,实现了全算力场景的覆盖。

开发者狂欢!Mac mini 搭 OpenClaw 造 AI 员工,iPhone 部署引热议

Qwen3.5 小模型的开源,让全球开发者迎来了端侧 AI 开发的狂欢,各路玩家纷纷晒出自己的落地玩法,其中最受欢迎的莫过于与 OpenClaw 的组合。有开发者直言,在 Mac mini 上运行 Qwen3.5,搭配 7×24 小时运行的 OpenClaw,就能打造出一个 AI 员工,其成本还不到一个月初级员工的工资,能实现睡眠时监控收件箱、自动草拟回复、标记重要事项等全自动化工作,大幅解放人力。

更让开发者兴奋的是,有网友透露 Qwen3.5 小模型不仅能在笔记本上运行,还能直接部署在手机上,此话一出,立刻引发全网追问 “如何在 iPhone 上运行?”,不少玩家已经摩拳擦掌,期待在移动设备上体验国产端侧大模型的极致性能。

当然,也有开发者保持理性,直言 Qwen3.5-4B 这类小模型仍有能力边界,比如在 GPQA Diamond 研究生水平推理中正确率约 45%,HMMT 数学测试中仅 15%,“它更像是智能自动补全工具,而非真正的思考伙伴,在高难度问题上出错概率仍较高。” 但不可否认的是,小模型在特定能力维度已达到 Gemini 3 Flash 等云端模型水平,足以在海量端边侧场景发挥实际效用。

开源即巅峰!国产端侧大模型,改写 AI 落地格局

此次阿里 Qwen3.5 小模型的开源,不仅让国产大模型在端侧领域占据了全球领先地位,更让 AI 的落地门槛大幅降低 —— 不再需要动辄上百 GB 显存的高端硬件,普通笔记本、手机、IoT 设备就能运行高性能大模型,这也为 AI 的普惠化发展奠定了核心基础。

从行业角度来看,小尺寸高智能模型的普及,将推动 AI 从云端走向 “端云协同”,尤其是与 OpenClaw 这类 AI 代理工具结合,能打造出低成本、高自动化的 AI 员工,为中小企业、个人开发者带来全新的生产力革命。而马斯克的盛赞,也从侧面印证了国产大模型的技术实力,在全球 AI 竞赛中,中国正凭借端侧创新走出属于自己的道路。

目前,Qwen3.5 全系列模型已在魔搭社区和Hugging Face正式开源,开发者可直接下载使用,小尺寸模型的基座模型也同步开源,为二次开发、场景定制提供了充足的空间。未来,随着端侧大模型的持续优化,AI 将真正渗透到生活、工作的每一个角落,而 Qwen3.5 的开源,无疑是这场变革的重要推手。